Se ha alcanzado un punto de inflexión en la ciberseguridad: un punto en el que los modelos de IA se han vuelto realmente útiles para las operaciones de ciberseguridad, tanto para bien como para mal. Esta afirmación se basa en evaluaciones sistemáticas que muestran que las capacidades se han duplicado en seis meses; y ya es posible estado rastrear ciberataques reales, observando cómo los actores maliciosos utilizan las capacidades de la IA.

A mediados de septiembre de 2025, la empresa Anthropic (creadores de Claude IA) detectó actividad sospechosa que, tras una investigación posterior, se determinó que era una campaña de espionaje altamente sofisticada. Los atacantes utilizaron las capacidades «agentes» de la IA a un grado sin precedentes, empleándola no solo como asesora, sino también para ejecutar los ciberataques directamente.

El actor de la amenaza —que, según la evaluación, era un grupo patrocinado por el Estado chino— manipuló la herramienta Claude Code para intentar infiltrarse en aproximadamente treinta objetivos globales y tuvo éxito en un pequeño número de casos. La operación tuvo como objetivo grandes empresas tecnológicas, instituciones financieras, empresas de fabricación de productos químicos y agencias gubernamentales. Este sería el primer caso documentado de un ciberataque a gran escala ejecutado sin una intervención humana significativa.

Al detectar esta actividad, iniciaron una investigación para comprender su alcance y naturaleza. Esta campaña tiene implicaciones sustanciales para la ciberseguridad en la era de los «agentes» de IA: sistemas que pueden funcionar de forma autónoma durante largos períodos y que completan tareas complejas prácticamente sin intervención humana. Los agentes son valiosos para el trabajo diario y la productividad, pero en manos equivocadas, pueden aumentar considerablemente la viabilidad de los ciberataques a gran escala.

Cómo funcionó el ciberataque

El ataque se basó en varias características de los modelos de IA que no existían, o estaban en una fase mucho más incipiente, hace apenas un año:

- Inteligencia. El nivel general de capacidad de los modelos ha aumentado hasta el punto de que pueden seguir instrucciones complejas y comprender el contexto de maneras que posibilitan tareas muy sofisticadas. Además, varias de sus habilidades específicas bien desarrolladas —en particular, la programación de software— se prestan para ser utilizadas en ciberataques.

- Autonomía. Los modelos pueden actuar como agentes; es decir, pueden ejecutarse en bucles donde toman acciones autónomas, encadenan tareas y toman decisiones con una mínima y ocasional intervención humana.

- Herramientas. Los modelos tienen acceso a una amplia gama de herramientas de software (a menudo a través del protocolo estándar abierto Model Context Protocol). Ahora pueden buscar en la web, recuperar datos y realizar muchas otras acciones que antes eran exclusivas de los operadores humanos. En el caso de los ciberataques, las herramientas pueden incluir programas para descifrar contraseñas, escáneres de red y otro software relacionado con la seguridad.

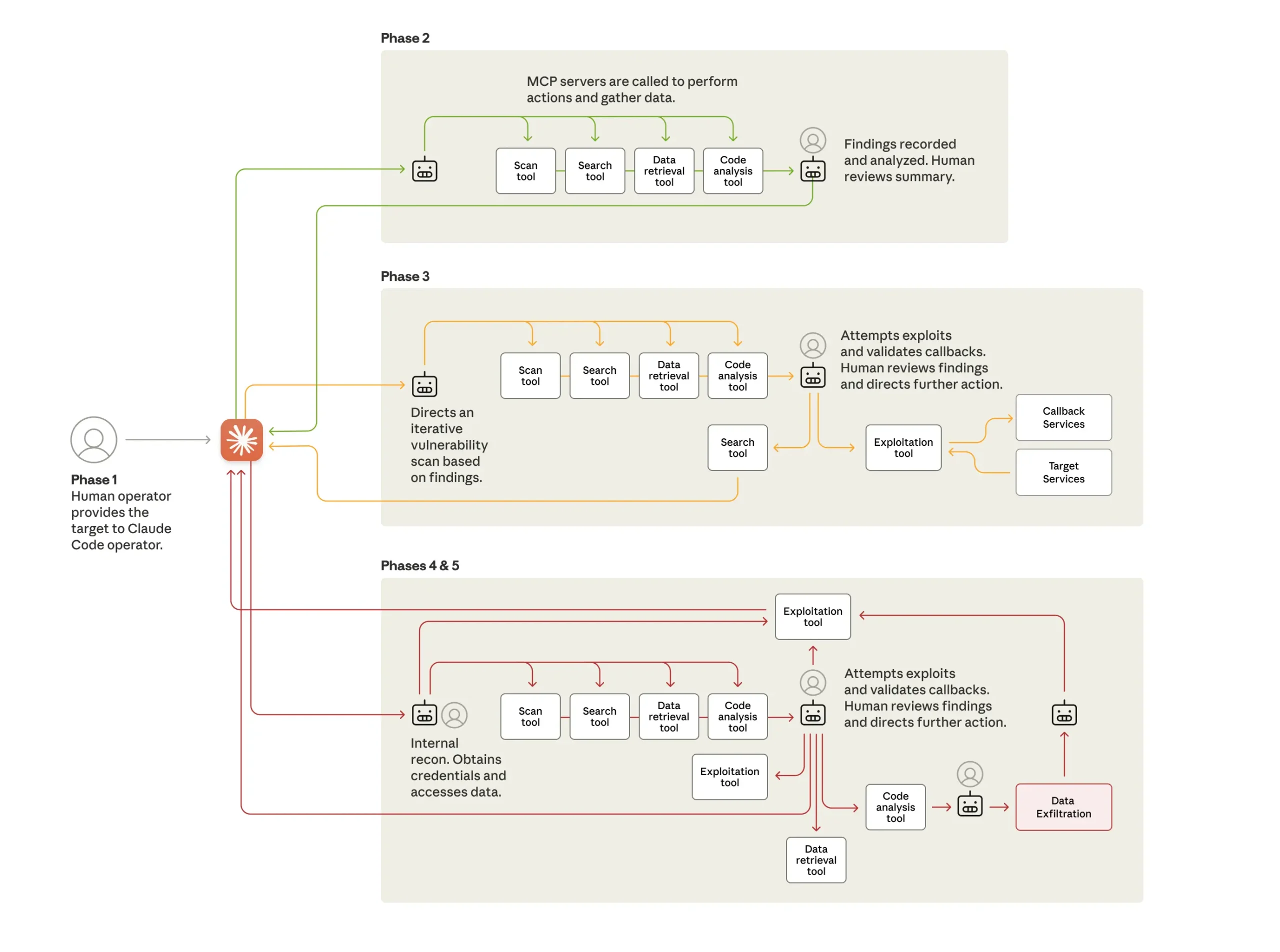

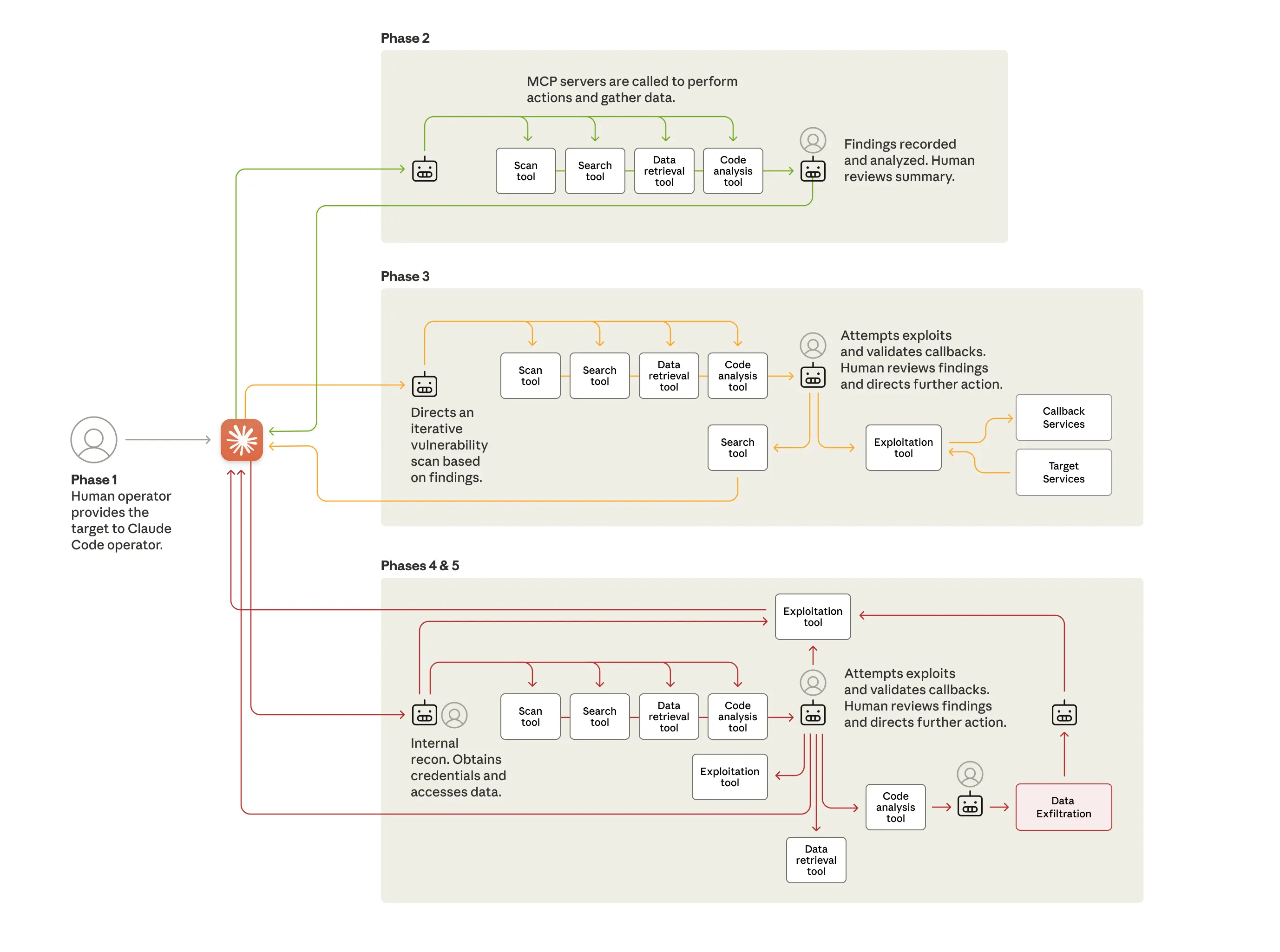

El diagrama siguiente muestra las diferentes fases del ataque, cada una de las cuales requirió los tres desarrollos mencionados anteriormente:

En la Fase 1, los operadores humanos seleccionaron los objetivos relevantes (por ejemplo, la empresa o agencia gubernamental a infiltrar). A continuación, desarrollaron un marco de ataque: un sistema diseñado para comprometer de forma autónoma un objetivo elegido con mínima intervención humana. Este marco utilizaba Claude Code como herramienta automatizada para llevar a cabo las operaciones cibernéticas.

En este punto, tuvieron que convencer a Claude —que está ampliamente entrenado para evitar comportamientos dañinos— de participar en el ataque. Lo lograron mediante el jailbreak, engañándolo para que eludiera sus medidas de seguridad. Dividieron sus ataques en tareas pequeñas y aparentemente inocentes que Claude ejecutaría sin conocer el contexto completo de su propósito malicioso. También le dijeron a Claude que era un empleado de una empresa legítima de ciberseguridad y que se estaba utilizando en pruebas defensivas.

Los atacantes iniciaron entonces la segunda fase del ataque, que consistía en que Claude Code inspeccionara los sistemas e infraestructura de la organización objetivo e identificara las bases de datos más valiosas. Claude pudo realizar este reconocimiento en una fracción del tiempo que le habría llevado a un equipo de hackers humanos. Posteriormente, el sistema informó a los operadores humanos con un resumen de sus hallazgos.

En las siguientes fases del ataque, Claude identificó y probó vulnerabilidades de seguridad en los sistemas de las organizaciones objetivo mediante la investigación y la creación de su propio código de explotación. Tras esto, el sistema pudo utilizar a Claude para obtener credenciales (nombres de usuario y contraseñas) que le permitieron acceder a información confidencial y extraer una gran cantidad de datos privados, los cuales clasificó según su valor informativo. Se identificaron las cuentas con mayores privilegios, se crearon puertas traseras y se extrajeron datos con una mínima supervisión humana.

En una fase final, los atacantes utilizaron a Claude para generar una documentación exhaustiva del ataque, creando archivos útiles con las credenciales robadas y los sistemas analizados, lo que ayudó al sistema a planificar la siguiente etapa de las operaciones cibernéticas del actor de amenazas.

En general, el actor de amenazas pudo utilizar IA para llevar a cabo entre el 80% y el 90% de la campaña, requiriendo intervención humana solo esporádicamente (quizás entre 4 y 6 puntos de decisión críticos por campaña de hackeo). La enorme cantidad de trabajo que realizaba la IA habría requerido muchísimo tiempo para un equipo humano. La IA realizaba miles de solicitudes por segundo, una velocidad de ataque que, para los hackers humanos, habría sido simplemente imposible de igualar.

Claude no siempre funcionaba a la perfección. En ocasiones, alucinaba con credenciales o afirmaba haber extraído información secreta que, de hecho, era de dominio público. Esto sigue siendo un obstáculo para los ciberataques totalmente autónomos.

Implicaciones para la ciberseguridad

Las barreras para realizar ciberataques sofisticados se han reducido considerablemente, y seguirán disminuyendo. Con la configuración adecuada, los ciberdelincuentes pueden usar sistemas de IA automatizados durante largos periodos para realizar el trabajo de equipos completos de hackers experimentados: analizar sistemas objetivo, generar código de explotación y escanear grandes conjuntos de datos de información robada con mayor eficiencia que cualquier operador humano. Grupos con menos experiencia y recursos pueden ahora realizar ataques a gran escala de esta naturaleza.

Este ataque supone una escalada incluso respecto a los hallazgos sobre «hacking basado en la percepción / vibe hacking» publicado este verano: en esas operaciones, los humanos seguían muy involucrados, dirigiendo las operaciones. En este caso, la participación humana fue mucho menos frecuente, a pesar de la mayor escala del ataque. Y aunque solo se tienen visibilidad del uso de Claude, este estudio de caso probablemente refleja patrones de comportamiento consistentes en los modelos de IA de vanguardia y demuestra cómo los ciberdelincuentes están adaptando sus operaciones para explotar las capacidades de IA más avanzadas de la actualidad.

Esto plantea una pregunta importante: si los modelos de IA pueden usarse indebidamente para ciberataques a esta escala, ¿por qué seguir desarrollándolos y lanzándolos? La respuesta es que las mismas capacidades que permiten usar a Claude en estos ataques también lo convierten en una herramienta crucial para la ciberdefensa.

Cuando inevitablemente se produzcan ciberataques sofisticados, el objetivo es que Claude ayude a los profesionales de ciberseguridad a detectar, interrumpir y prepararse para futuras versiones del ataque. De hecho, los equipos de Inteligencia de Amenazas utilizó ampliamente a Claude para analizar la ingente cantidad de datos generados durante esta investigación.

Se ha producido un cambio fundamental en la ciberseguridad. Recomendamos a los equipos de seguridad que experimenten con la aplicación de la IA para la defensa en áreas como la automatización del Centro de Operaciones de Seguridad (SOC), la detección de amenazas, la evaluación de vulnerabilidades y la respuesta a incidentes.

También recomendamos a los desarrolladores que sigan invirtiendo en medidas de seguridad en sus plataformas de IA para prevenir el uso indebido por parte de adversarios. Sin duda, las técnicas descritas anteriormente serán utilizadas por muchos más atacantes, lo que hace que el intercambio de información sobre amenazas en el sector, la mejora de los métodos de detección y el fortalecimiento de los controles de seguridad sean aún más cruciales.