La inteligencia artificial (IA) está en auge, al igual que la preocupación por su seguridad y privacidad. Estas guías son documentos que proporcionan información clara y práctica sobre el diseño, la creación, las pruebas y la adquisición de sistemas de IA seguros y que preserven la privacidad.

El

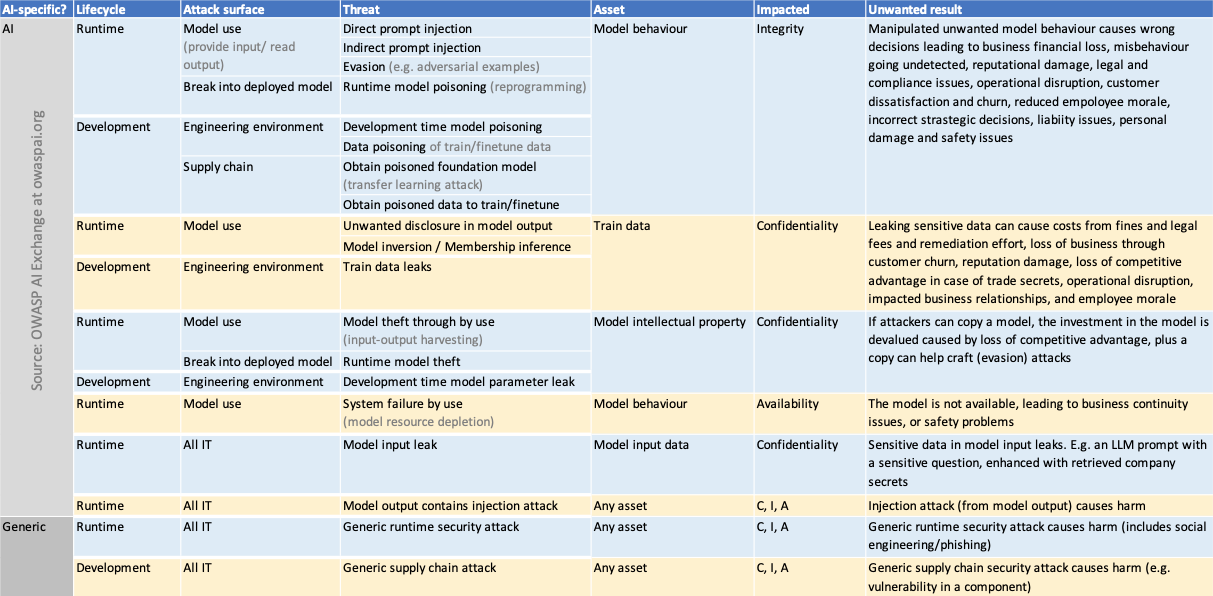

OWASP AI Exchange

es un marco integral de amenazas, controles y mejores prácticas relacionadas

con la IA, alineado activamente con los estándares internacionales y que los

complementa. Abarca todos los tipos de IA y, además de la seguridad, también

aborda la privacidad.

OWASP AI Exchange es el recurso principal para la seguridad y privacidad de la

IA: más de 200 páginas de consejos prácticos y referencias sobre la protección

de la IA y los sistemas centrados en datos contra amenazas, donde la IA se

compone de IA Analítica, IA Discriminativa, IA Generativa y sistemas

heurísticos. Este contenido sirve como referencia clave para los profesionales

y contribuye de forma activa y sustancial a estándares internacionales como

ISO/IEC y la Ley de IA a través de colaboraciones oficiales para la

normalización.

El Proyecto de Seguridad GenAI de OWASP es un proyecto paraguas de varias iniciativas que publican documentos

sobre seguridad de la IA Generativa, incluyendo la Lista de Verificación de

Seguridad y Gobernanza de la IA del LLM y el Top 10 del LLM, que presenta los

riesgos de seguridad más graves de los Grandes Modelos de Lenguaje.

Si desea garantizar la seguridad o la privacidad de su sistema de IA o

centrado en datos (con o sin GenAI), o si desea saber hacia dónde se dirige la

estandarización de la seguridad de la IA, puede utilizar el AI Exchange. Desde allí, se le remitirá a material adicional relevante (incluido el

material del proyecto de seguridad GenAI) cuando sea necesario.

Si desea obtener una visión general de las principales preocupaciones de

seguridad para los Modelos de Lenguaje Grandes (LLM), consulte el

Top 10 del LLM del proyecto GenAI.

El Intercambio de IA es un recurso único y coherente sobre cómo proteger los

sistemas de IA, que se presenta en este sitio web y está dividido en varias

páginas.

Cómo empezar

Si desea proteger su sistema de IA, comience con un

análisis de riesgos

que le guiará a través de una serie de preguntas que le permitirán identificar

los ataques aplicables.

Si desea obtener una visión general de los ataques desde diferentes

perspectivas, consulte el

modelo de amenazas de IA

o la

matriz de seguridad de IA. Si conoce el ataque contra el que necesita protegerse, búsquelo en la

visión general que prefiera y haga clic para obtener más información y saber

cómo hacerlo.

Fuente: OWASP AI