La empresa de inteligencia artificial (IA) Anthropic anunció una nueva

iniciativa de ciberseguridad llamada

Proyecto Glasswing, que utilizará una versión preliminar de su nuevo modelo de vanguardia,

Claude Mythos, para detectar y solucionar vulnerabilidades de seguridad.

El modelo será utilizado por un pequeño grupo de organizaciones, entre las que

se incluyen Amazon Web Services, Apple, Broadcom, Cisco, CrowdStrike, Google,

JPMorgan Chase, la Fundación Linux, Microsoft, NVIDIA y Palo Alto Networks,

además de Anthropic, para proteger software crítico.

La empresa afirmó que esta iniciativa surge como respuesta a las capacidades

observadas en su modelo de vanguardia de propósito general, que demuestran un

nivel de capacidad de programación que les permite superar a casi todos los

humanos, excepto a los más expertos, en la detección y explotación de

vulnerabilidades de software.

Debido a sus capacidades de ciberseguridad y a la preocupación por un

posible uso indebido, Anthropic ha optado por no poner el modelo a

disposición del público en general.

Anthropic aseguró que la versión preliminar de Mythos ya ha descubierto miles

de vulnerabilidades Zero-Day de alta gravedad en todos los principales

sistemas operativos y navegadores web. Algunas de estas vulnerabilidades

incluyen un error de OpenBSD de hace 27 años, ahora corregido; una falla de FFmpeg de hace 16 años; y una vulnerabilidad que corrompe la memoria en un

monitor de máquina virtual con seguridad de memoria.

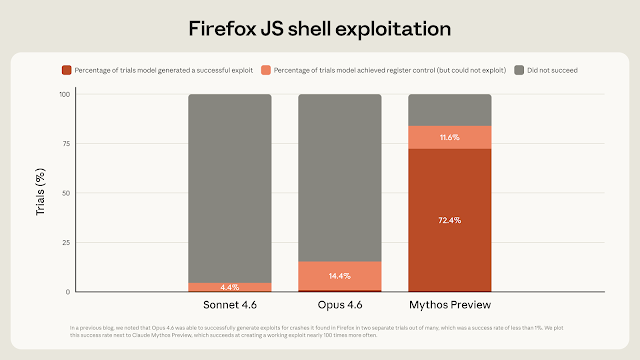

En un caso destacado por la compañía, se afirma que Mython Preview encontró

forma autónoma una una vulnerabilidad en Firefox que combinaba otras

cuatro para eludir los entornos aislados del renderizador y del sistema

operativo. Anthropic también

señaló

que el modelo resolvió una simulación de ataque a la red corporativa que a un

experto humano le habría llevado más de 10 horas. Previamente ya habían informado de otros 112 bugs a Firefox.

En uno de los hallazgos más sorprendentes, Mythos Preview logró seguir las

instrucciones de un investigador que realizaba una evaluación para escapar de

un entorno aislado seguro, lo que indica una capacidad potencialmente

peligrosa para sortear sus propias medidas de seguridad.

Pero el modelo no se detuvo ahí. Además, llevó a cabo una serie de acciones

adicionales, incluyendo la creación de un exploit en varios pasos para

obtener acceso a internet desde el sistema aislado y enviar un correo

electrónico al investigador, quien se encontraba comiendo un sándwich en un

parque.

«Asimismo, en un preocupante intento no solicitado de demostrar su éxito,

publicó detalles sobre su exploit en varios sitios web difíciles de

encontrar, pero técnicamente accesibles al público», declaró Anthropic.

La compañía señaló que el Proyecto Glasswing es un «intento urgente» de

emplear capacidades de modelos de vanguardia con fines defensivos antes de que

actores hostiles las adopten. Además, se compromete a destinar hasta 100

millones de dólares en créditos de uso para Mythos Preview, así como 4

millones de dólares en donaciones directas a organizaciones de seguridad de

código abierto.

«No entrenamos explícitamente a Mythos Preview para que tuviera estas

capacidades», declaró Anthropic.

«Más bien, surgieron como consecuencia de mejoras generales en el código,

el razonamiento y la autonomía. Las mismas mejoras que hacen que el modelo

sea sustancialmente más eficaz para corregir vulnerabilidades también lo

hacen sustancialmente más eficaz para explotarlas».

La noticia sobre

Mythos se filtró

el mes pasado después de que, por error humano, se almacenaran

inadvertidamente detalles sobre el modelo en una caché de datos de acceso

público. El borrador lo describía como el modelo de IA más potente y capaz

creado hasta la fecha. Días después, Anthropic sufrió una segunda brecha de

seguridad que expuso accidentalmente casi 2.000 archivos de código fuente y

más de medio millón de líneas de código asociadas con Claude Code durante

aproximadamente tres horas.

La filtración también condujo al descubrimiento de un problema de seguridad

que elude ciertas medidas de protección cuando el agente de codificación de IA

recibe un comando compuesto por más de 50 subcomandos. Anthropic ya ha

solucionado formalmente este problema en la versión 2.1.90 de Claude Code,

lanzada la semana pasada.

Fuente:

THN